从100页的GPT-4技术报告中我收获了什么?

背景介绍:

2023 年 3 月 14 日(3.14?圆周率巧合?是OpenAI有意为之,还是无心之举?),OpenAI发布了GPT-4,而在5天前,OpenAI发布了GPT4的技术报告,这份PDF报告足足有100页之多,当然,这100页的报告中其中一多半为附录和参考资料,那么即便如此,从这份报告中,我都有哪些收获呢?

GPT-4与之前的版本相比有哪些优点?

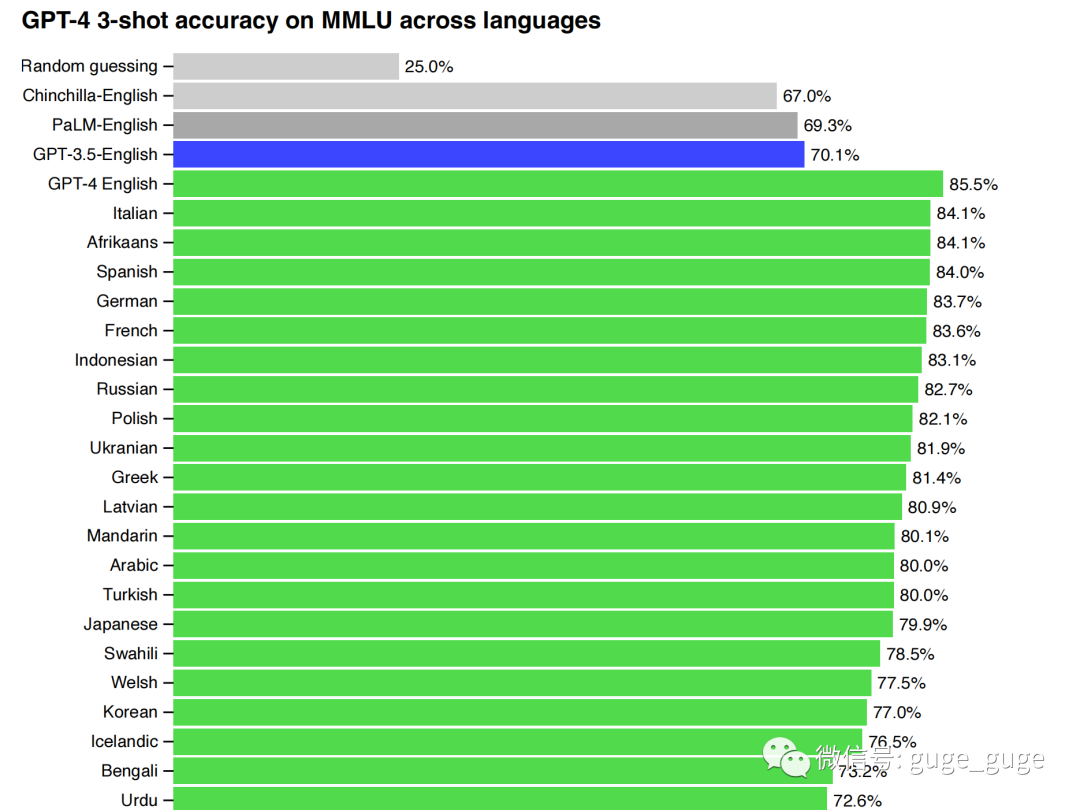

根据报告第8页内容,GPT-4在大多数语言测试中都优于现有英语语言模型表现,包括资源匮乏的小语种(如拉脱维亚语、威尔士语和斯瓦希里语)。此外,GPT-4还是一个多模态模型,可以接受图像和文本输入并生成文本输出。它还通过预训练来预测文档中的下一个标记,并通过后训练对齐过程来提高事实性和遵循所需行为的性能。因此,相对于之前的版本,GPT-4具有更好的性能和更广泛的应用范围。

GPT-4的能力表现如何?

在报告的第2页中,主要关注了GPT-4的能力、限制和安全性质。GPT-4是一种Transformer-Style模型,使用公开可用的数据(如互联网数据)和从第三方厂商获得的数据进行预训练,然后使用人类反馈的强化学习进行微调。该模型可以完成多个基本任务,例如确定与电话号码相关联的地理位置或回答教育机构位于何处等。

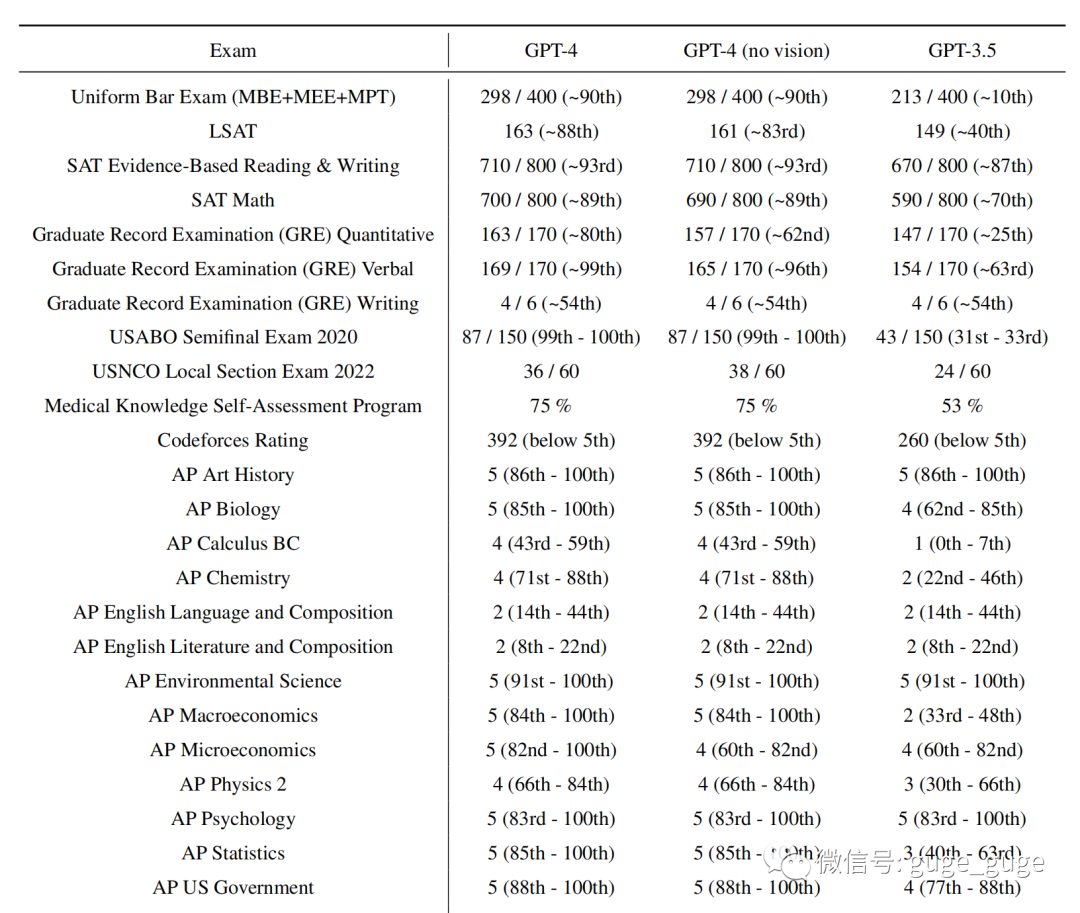

而在报告的第5页,GPT-4在各种专业和学术基准测试中表现出人类水平的性能,包括通过模拟考试条件和评分的方式来通过模拟的律师考试,并获得了大约排名前10%的成绩。

关于视觉输入:

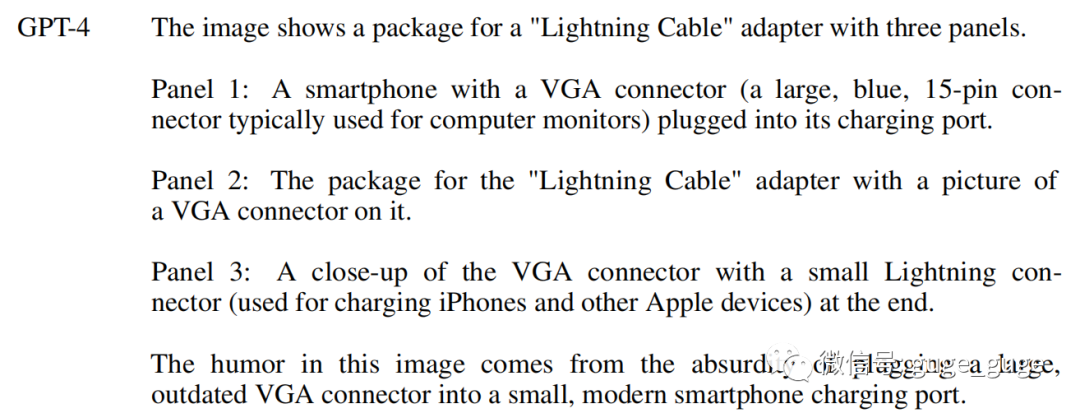

根据第8页,GPT-4接受由图像和文本组成的提示,这使得用户可以指定任何视觉或语言任务,在包括带有文本和照片、图表或屏幕截图的文档在内的一系列领域中,GPT-4表现出与文本输入相似的能力。在使用图像和文本时,针对语言模型开发的标准测试技术(例如few-shot prompting、chain-of-thought等)同样有效。

如上图,给GPT-4 三张图片并询问它,AI给出的回答是这样的:

原文:

译文:

该图显示了带有三个面板的“Lightning Cable”适配器的包装。

面板1:带有 VGA 连接器(一种大的蓝色 15 针连接器,通常用于计算机显示器)的智能手机已插入其充电端口。

面板2:“Lightning Cable”适配器包装,图片为

上面有一个 VGA 连接器。

面板3:VGA 连接器特写,末端有一个小型闪电连接器(用于为 iPhone 和其他 Apple 设备充电)。

这张图片中的幽默是将过时的 VGA 连接器插入小型现代智能手机充电端口。

GPT-4有哪些局限性?

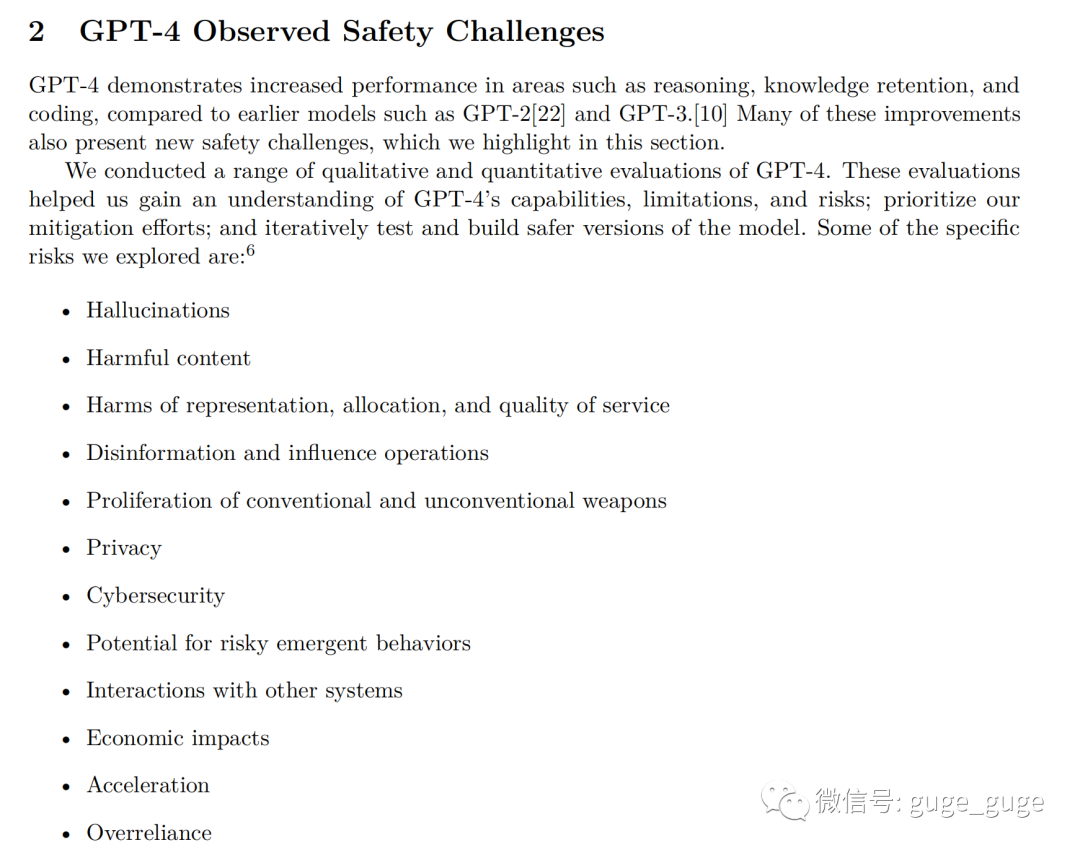

根据第44页内容,GPT-4-early和GPT-4-launch依然存在许多与早期语言模型相同的限制,例如产生偏见和不可靠的内容。在OpenAI采取缓解措施之前,他们还发现GPT-4-early在寻找销售非法商品或服务的网站、或是计划攻击等方面存在增加的风险。此外,报告还列出了其他一些具体风险,如幻觉、有害内容、虚假信息和影响操作、隐私、网络安全等。

关于网络安全风险,GPT-4-early和GPT-4-launch包括但不限于:网络安全漏洞、恶意软件、黑客攻击、数据泄露等。此外,GPT-4还可能生成有害的代码,例如用于攻击其他系统的代码。

GPT-4 面临哪些安全挑战?

根据第43页内容,为了缓解GPT-4的风险,OpenAI在开发和部署过程的各个步骤中采取了以下措施:

1. 在预训练数据集中减少违反使用政策(如不适当的色情内容)的某些内容类型的普遍性

2. 对模型进行微调,以拒绝某些指令,例如直接请求非法建议。

3. 减少模型产生幻觉的倾向,并通过利用先前模型使用的数据,减少模型容易受到对抗性提示或攻击(包括有时被称为“越狱”的攻击)的外围应用。

此外,在第42页中提到在大多数情况下,由于采取了安全缓解措施,GPT-4-launch表现出更安全的行为。

结论:OpenAI在GPT-4的开发和部署过程中实施了各种安全措施和流程,已经减少了其生成有害内容的能力。然而,GPT-4仍然可能受到对抗性攻击和漏洞利用的影响,这些攻击被称为“越狱”,而有害内容并不是风险的根源。微调可以修改模型的行为,但预训练模型的基本能力(如生成有害内容的潜力)仍然存在。因此,在使用GPT-4时需要采取适当的安全措施以减少这些风险。

关于隐私问题:

第53页,报告提到OpenAI已经采取了一些措施来保护用户隐私,包括限制访问训练数据、对数据进行匿名化处理、限制模型的使用等。此外,OpenAI还在努力进一步提高其隐私保护能力。具体措施的细节并未在该报告中详细说明。

是否有一些不可预估或未知的问题?

根据报告第41页内容,尽管OpenAI已经采取了各种安全措施和流程来减少GPT-4的风险,但这些措施仍然存在局限性,并且在某些情况下仍然脆弱。此外,由于GPT-4是一个非常复杂的模型,我们可能无法预测所有可能的行为和结果。因此,我们需要进行预见性规划和治理以应对未知情况。