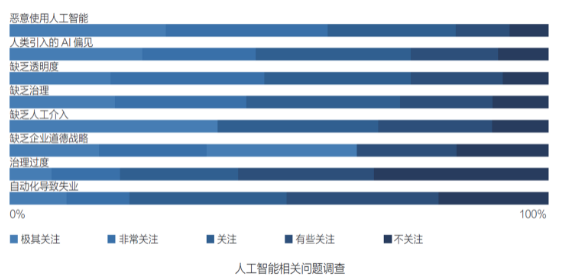

2024年2月29日,奇安信集团正式公布了《2024人工智能安全报告》(以下简称《报告》)。《报告》详细分析了人工智能技术在全球范围内的安全挑战与威胁。《报告》指出,2023年,基于AI的深度伪造欺诈事件数量激增了惊人的30倍,同时基于AI的钓鱼邮件数量也大幅攀升,增长了高达10倍。更令人担忧的是,已有多个国家支持的先进持续性威胁(APT)组织利用人工智能技术成功实施了十余起网络攻击事件。这些事件充分显示,人工智能技术的恶意利用正迅速增长,并在政治安全、网络安全、物理安全和军事安全等多个领域构成了严重且紧迫的威胁。

自2022年以来,以ChaGPT为代表的人工智能技术崭露头角,其展现出的强大能力和显著效果震撼了全球。据IDC的调研数据,已有67%的中国企业开始积极探索AIGC(人工智能与生成式计算)在企业内部的应用潜力,并为此投入了大量资金。IDC预测,到2026年,中国AI大模型市场规模将高达211亿美元,这标志着人工智能即将迎来其大规模实际应用的关键阶段。

然而,《报告》也强调,“AI作为一种通用技术,其通用性意味着它既可以被用来创造美好,也可能被用于制造混乱。”具有巨大潜力的AI技术同时带来了两大核心挑战:一方面,它可能会加剧和放大现有的安全威胁;另一方面,AI还可能催生全新的安全风险。据《报告》显示,2023年基于AI的深度伪造欺诈事件激增了惊人的3000%,同时基于AI的钓鱼邮件数量也飙升了1000%。奇安信威胁情报中心更是监测到,已有多个国家支持的先进持续性威胁(APT)组织利用AI技术成功实施了十余起网络攻击事件。这些事件再次凸显了人工智能技术在应用过程中所面临的复杂安全挑战。

《报告》详尽探讨了基于AI的深度伪造(Deepfake)、黑产大语言模型基础设施、利用AI的自动化攻击、AI武器化、LLM自身的安全风险、恶意软件、钓鱼邮件、虚假内容和活动生成、硬件传感器安全等12大关键威胁。通过对这些威胁的技术原理、潜在危害以及真实案例的深入分析,旨在提醒业界全面认识AI普及所带来的威胁与挑战。随着技术的不断演进,这些基于AI的新型攻击方式和手段层出不穷,已在全球范围内造成了不容忽视的严重危害。我们必须保持高度警惕,采取有效措施来应对这些新兴的安全风险。

《报告》进一步指出,AI与大语言模型自身便伴随着一定的安全风险,然而,行业内对这些潜在影响的研究与重视程度仍然远远不够。全球知名的应用安全组织OWASP已经发布了大模型应用的十大安全风险,其中包括提示注入、数据泄漏、沙箱不足以及未经授权的代码执行等问题。此外,训练语料中存在的不良信息也导致了生成的内容存在安全隐患,这正在持续引发灾难性的后果,对国家安全、公共安全以及个人安全构成严重威胁。因此,行业内必须高度重视这些风险,并积极采取相应的应对措施来确保AI与大语言模型的安全应用。

《报告》从多个维度为应对AI威胁提供了具体建议。对于安全行业而言,需要充分发挥其能力优势,确保人工智能技术的自身安全性,并积极探索将AI技术应用于安全防护的新路径。监管机构则需持续关注AI的潜在风险与影响,及时在制度和法规层面给予支持和引导。政企机构在AI安全方面,不仅需要部署相应的安全框架和解决方案,还需引入AI安全评估服务和检测工具,以AI技术推动整体安全体系的升级。与此同时,网络用户在享受最新AI应用带来的便利时,也需不断更新安全知识,培养稳健的安全操作习惯。

FreeBuf

FreeBuf

Coremail邮件安全

Coremail邮件安全

安全牛

安全牛

Anna艳娜

Anna艳娜

ManageEngine卓豪

ManageEngine卓豪

Anna艳娜

Anna艳娜

Andrew

Andrew

RacentYY

RacentYY

Andrew

Andrew

X0_0X

X0_0X

Anna艳娜

Anna艳娜

Anna艳娜

Anna艳娜