再见!谷歌翻译……

就在这两天,有网友突然发现谷歌翻译用不了。

(虽然谷歌退环境了,但翻译一直是能用的)

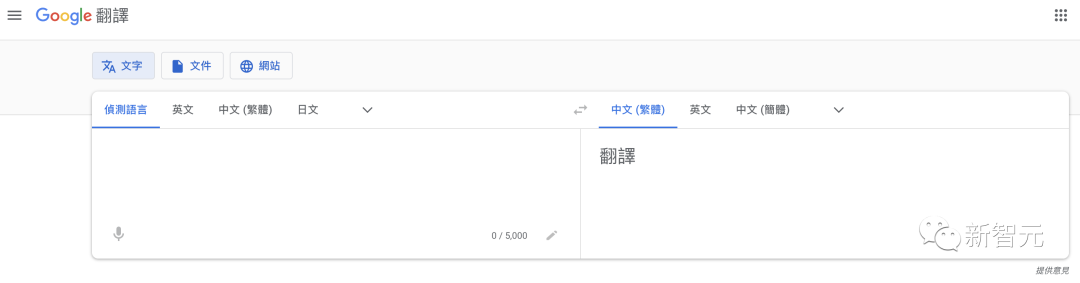

具体来说,本应提供翻译功能的translate.google.cn,被替换成了一个所谓的「搜索页面」。

就是长下面这样的:

那么问题来了,谷歌不是早就退出了么,哪儿来的搜索?

没错,因为这就是个「截图」而已……

不管你点击哪里,都会直接被重新定向到谷歌翻译的香港域名——translate.google.hk。

显然,这个对于大陆的用户来说,是无法访问的。

于是,不管是谷歌Chrome内置的翻译功能,还是其他调用了这一接口的软件,比如KOReader(一种文档查看器),都祭了……

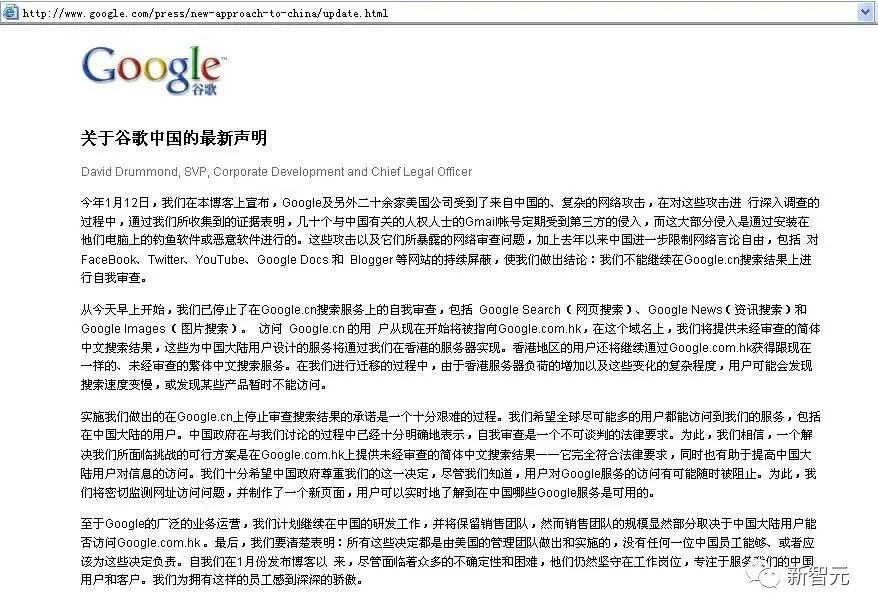

顺便一提,谷歌2010年退出中国内地市场。

时任工业和信息化部部长李毅中同年3月12日在回应「谷歌退出中国事件」时说,中国的互联网是开放的,进入中国市场就必须遵守中国法律。

此前曾有报道称,谷歌在2018年和2019年都曾尝试过在中国大陆重新启动搜索服务。

作为「蜻蜓计划」的一部分,该项目将对搜索结果进行审查,并记录用户的位置以及他们的互联网浏览历史。

但据The Intercept报道,在经历了由内部隐私团队牵头的冲突之后,谷歌彻底放弃了这一计划。

曾陷「辱华」风波

去年11月,有网友发现谷歌翻译会将一些艾滋病相关的词翻译为中国侮辱性词汇,引发对谷歌翻译的反感和愤怒。

在英翻中的英文对话框输入「新闻」,「传播」等词汇,中文部分显示的仍然是「新闻」和「传播」。

但在英文对话框输入「艾滋病毒」等类似词汇,中文翻译就会显示恶毒攻击中国的词汇。

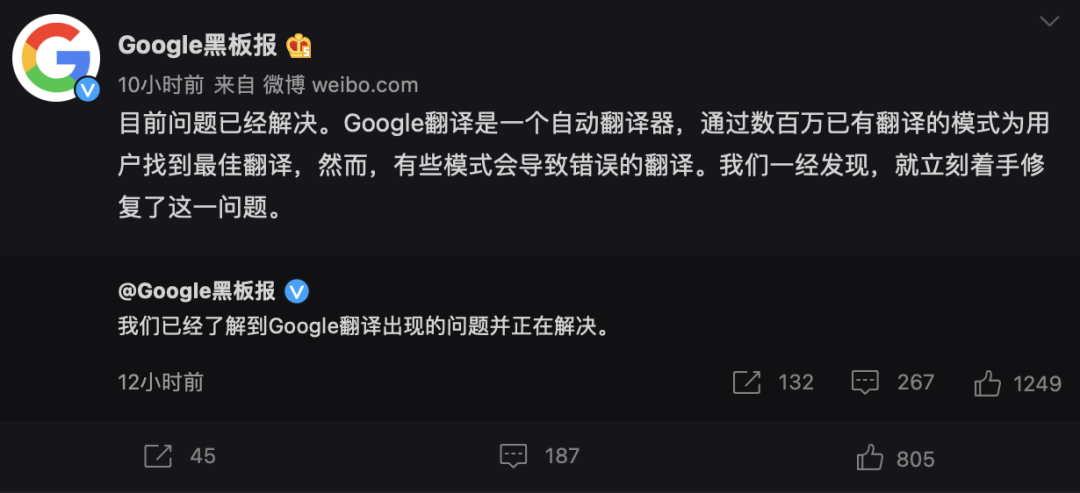

不过,谷歌很快便在微博上表示,问题已经得到了解决,并解释称是由「模式」引发的。

也就是说训练语料要背大锅,如果训练语料存在夹带私货的情况,那翻译结果也不会准确。

对此,「NeX8yte」指出,国际互联网上中文的语料大部分并不掌握在我们自己手里,而且此类结果很可能是经过了中介语言,从而也就放大了错误。

银蓝剑6H17也表示,这种结果的出现一方面是机器学习用了脏语料,让部分中文输入也可以输出翻译结果,另外一方面就是模型到API的调用阶段管理出现了真空。

「曹哲的杂货铺」认为这是有意制造的:

为什么恰好会有人找到谷歌翻译,又恰好翻译这些并不常用的词语,又双叒叕恰好把忽略系统建议硬把源语言设成「英文」呢?

输入一段中文,然后硬告诉程序这是英文,让他把这玩意「翻译」成中文,其直接后果无非就是程序被你玩炸了,程序会认为这条「英文」它不会翻译,这时候只要有心人把这个用汉语写成的「冷门英文单词」在翻译社区提交翻译建议,就很容易达成这种结果。

参考资料:

https://tcrn.ch/3E6HC3b